作者: 兆光科技 發(fā)布時間: 2024/08/09 點擊: 4670次

“更好(hǎo)的技術必然會提高人們的生活水平” 的說法,已不再另人信服。

技術是一把雙刃劍,AI 也不例外,至少現在是這(zhè)樣(yàng)。ChatGPT、Midjourney 等 AI 工具誕生後(hòu),有人喜,有人憂。

一方面(miàn),一些傳統公司將(jiāng)這(zhè)些 AI 工具應用到公司的實際業務中,實現了降本增效;另一方面(miàn),部分人類打工人卻因被(bèi) AI 工具替代而面(miàn)臨失業的危機。

一個值得關注的新聞是,在剛剛過(guò)去的五一勞動節期間,IBM 宣布暫緩可以被(bèi) AI 替代的崗位的招聘,而且諸如此類的事(shì)件可能(néng)越來越多。

那麼(me),随著(zhe) AI 變得越來越強大,各種(zhǒng) AI 系統也將(jiāng)會被(bèi)越來越多地服務于各行各業,屆時,AI 是將(jiāng)扮演一個“資本的順從執行者”(capital’s willing executioners),還(hái)是可以真正改善人們的生活、實現一個烏托邦式的未來?

近日,華裔美國(guó)科幻小說作家 Ted Chiang(姜峯楠)在《紐約客》發(fā)文,探讨了“AI 是否會成(chéng)爲下一個麥肯錫”的問題——這(zhè)家公司爲 90% 的 Fortune 100 上榜公司提供服務,被(bèi)前雇員稱爲資本公司用來逃避責任的“打手”。

核心觀點如下:

幫助資本家逃避責任,是管理咨詢公司提供的最有價值的服務之一。如今,AI 也成(chéng)爲了他們逃避責任的一種(zhǒng)方式。

建立奉行 “股東利益高于一切” 的 AI 可能(néng)永遠都(dōu)是受歡迎的,大多數公司也更願意使用這(zhè)種(zhǒng) AI,而不是一個受你的原則約束的 AI。

當前,AI 大多是一種(zhǒng)試圖分析人類行爲并找到取代人類方法的努力。恰巧,這(zhè)也正是一些管理層希望解決的問題。

不太相信 AI 會因爲可能(néng)制定自己的目标并阻止我們關閉它而對(duì)人類産生威脅的說法。然而,AI 是危險的,因爲它增加了一些人的權力。

我們處于這(zhè)樣(yàng)一種(zhǒng)情況中:技術與資本/金錢混淆在一起(qǐ),而資本/金錢又與進(jìn)步的概念混淆在一起(qǐ)。如果你試圖批評他們,就會被(bèi)指責反對(duì)技術和進(jìn)步。

“更好(hǎo)的技術必然會提高人們的生活水平” 的說法已不再令人信服。

技術能(néng)夠提高生活水平的唯一途徑是,有适當的經(jīng)濟政策來分配技術的好(hǎo)處。

AI 肯定會降低勞動力成(chéng)本,增加企業的利潤,但這(zhè)與改善我們的生活水平完全不同。

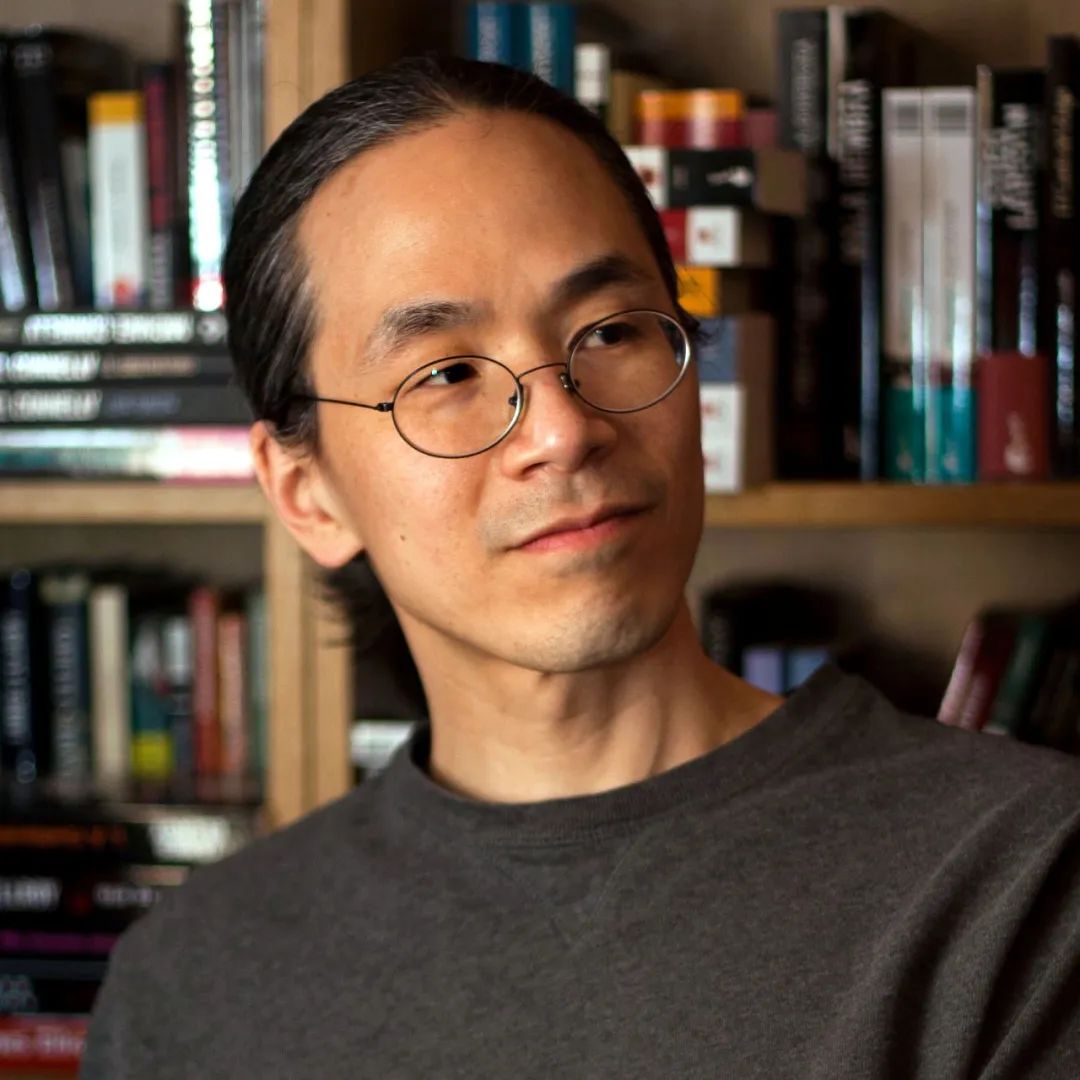

圖|Ted Chiang(姜峯楠),華裔美國(guó)科幻小說作家,曾獲得四項星雲獎、四項雨果獎、約翰·W·坎貝爾最佳新作家獎、四項軌迹獎等。他的短篇小說《你一生的故事(shì)》在 2016 年被(bèi)改編成(chéng)電影《降臨》。(來源:維基百科)

學(xué)術頭條(ID:SciTouTiao)在不改變原文大意的情況下,做了簡單的編譯。内容如下:

每當我們談論人工智能(néng)(AI)時,我們都(dōu)會使用一些隐喻(metaphor),就像我們在面(miàn)對(duì)新的和不熟悉的事(shì)物時所表現的那樣(yàng)。

從本質上講,隐喻是不完美的,但我們依然需要謹慎地去選擇它們,因爲糟糕的隐喻會讓我們犯錯誤。例如,我們經(jīng)常將(jiāng)強大的 AI 比作童話故事(shì)中的精靈,用來強調讓強大的個體服從你的命令是非常困難的。

計算機科學(xué)家 Stuart Russell 則引用了有關 Midas 國(guó)王的寓言故事(shì),來說明一個 AI 做你告訴它的事(shì)情而非你想要它做的事(shì)情的危險性。(Midas 獲得了“點石成(chéng)金”能(néng)力,卻一度遭遇了巨大的災難。)

這(zhè)個隐喻存在很多問題,其中之一是,它從指向(xiàng)的故事(shì)中得出了錯誤的結論。這(zhè)一寓言的重點是,貪婪之心會毀掉你,一味地追求金錢會讓你失去真正重要的東西。如果你對(duì)這(zhè)個寓言的解讀是,當你被(bèi)答允可以實現任何一個願望時,你應該非常謹慎地說出這(zhè)一願望,那你就錯了。

因此,我將(jiāng)針對(duì) AI 可能(néng)帶來的風險提出另一個隐喻:把 AI 類比成(chéng)一家管理咨詢公司,如麥肯錫(McKinsey & Company),其與 90% 的 Fortune 100 上榜公司合作。

像麥肯錫這(zhè)樣(yàng)的公司會因各種(zhǒng)原因被(bèi)雇用,而 AI 系統也會因各種(zhǒng)原因被(bèi)使用。而且,麥肯錫和 AI 之間的相似點非常明顯。社交媒體借助 AI 算法讓用戶沉迷于其中;類似地,普渡制藥(Purdue Pharma)曾在麥肯錫的幫助下大大增加了 OxyContin 在阿片類藥物泛濫時的銷售額。就像 AI 被(bèi)認爲可以爲管理者提供廉價的人類勞動力替代品一樣(yàng),麥肯錫和其他類似公司也讓大規模裁員的現象更加常見。

一名前麥肯錫雇員將(jiāng)這(zhè)家公司描述爲“資本的順從執行者”(capital’s willing executioners):如果你想做一件事(shì),但不想弄髒自己的手,麥肯錫可以幫助你。(幫你)逃避責任,是管理咨詢公司提供的最有價值的服務之一。

老闆們想要實現一些目标,但不想因爲采取一些必要的行動而受到指責,通過(guò)聘請咨詢顧問,他們可以反駁說,自己隻是聽取了來自第三方的專業建議。放眼現在,AI 也成(chéng)爲了他們逃避責任的一種(zhǒng)方式,他們說,自己隻是做了“算法”建議的事(shì)情而已。

我們需要關心的問題是:AI 變得越來越強大,我們有沒(méi)有辦法避免它成(chéng)爲下一個“麥肯錫”?這(zhè)一問題需要從不同的角度來思考。

如果你認爲 AI 是一項被(bèi)廣泛使用的技術,能(néng)夠幫助公司降低成(chéng)本,那問題就可以描述爲:我們如何防止這(zhè)一技術被(bèi)用作爲“資本的順從執行者”?

或者,如果你把 AI 想象成(chéng)一個半自主的軟件程序,解決人類要求它解決的問題,那問題就變成(chéng)了:如何防止這(zhè)一軟件以讓人們生活變得更糟的方式來幫助公司?假設你已經(jīng)建立了一個完全服從于人類的半自主人工智能(néng),但它依然很容易像麥肯錫那樣(yàng)給社會帶來危害。

你不能(néng)簡單地說,你將(jiāng)建立一個隻解決你提出的問題且可以創造積極社會影響的 AI。這(zhè)就相當于說,你可以通過(guò)創辦一家隻提供這(zhè)種(zhǒng)解決方案的咨詢公司且能(néng)規避麥肯錫帶來的威脅。

但現實情況是,Fortune 100 公司依然會雇用麥肯錫,因爲麥肯錫的解決方案能(néng)爲股東們提供更多利益。建立奉行 “股東利益高于一切” 的 AI 可能(néng)永遠都(dōu)是受歡迎的,大多數公司也更願意使用這(zhè)種(zhǒng) AI,而不是一個受你的原則約束的 AI。除了成(chéng)爲 “資本的順從執行者”,AI 還(hái)能(néng)做些什麼(me)?

當前,AI 大多是一種(zhǒng)試圖分析人類行爲并找到取代人類方法的努力。恰巧,這(zhè)也正是一些管理層希望解決的問題。因此,AI 以犧牲人類勞動者的利益爲代價被(bèi)用來幫助資本。

實際上,真的沒(méi)有什麼(me)比勞動咨詢公司更能(néng)促進(jìn)勞動者利益的了。AI 能(néng)否扮演這(zhè)一角色呢?又是否可以做一些有利于勞動者而非管理層的事(shì)情?

有人可能(néng)會說,反對(duì)管理層并不是 AI 要做的工作。這(zhè)也許是正确的,但 AI 的能(néng)力也不是用來強化資本。不幸的是,目前的情況正是如此。如果我們不能(néng)想辦法讓 AI 減少财富集中,就很難說 AI 是一種(zhǒng)中立的技術,更無法說它是一種(zhǒng)有益的技術了。

很多人認爲,AI 會造成(chéng)更多的失業,并提出了將(jiāng)全民基本收入(UBI)作爲解決這(zhè)個問題的方法。

放在其他情景下,我很喜歡 UBI 這(zhè)一想法。但是,對(duì)于 AI 從業者建議用 UBI 作爲解決失業問題的方法,我表示懷疑。如果我們已經(jīng)有了 UBI ,情況會有所不同,但事(shì)實上我們并沒(méi)有,所以這(zhè)似乎是他們把責任推給政府的一種(zhǒng)方式。

實際上,他們正在加劇資本集中造成(chéng)的問題,并期望當這(zhè)些問題變得足夠糟糕時,政府將(jiāng)别無選擇,隻能(néng)介入。作爲讓世界變得更美好(hǎo)的戰略,這(zhè)似乎值得懷疑。

有一種(zhǒng)哲學(xué)思想是,讓事(shì)情變得更好(hǎo)的唯一方法是讓事(shì)情變得更糟。我認爲,這(zhè)是帶來一個更好(hǎo)的世界的方法之一,但是,如果這(zhè)是 AI 行業正在采用的方法,每個人都(dōu)應該清楚他們正在努力實現什麼(me)。

通過(guò)建立 AI 系統來完成(chéng)之前由人類完成(chéng)的工作,AI 從業者正在將(jiāng)财富的集中度提高到極端水平,以至于避免社會崩潰的唯一方法就是政府介入。

事(shì)實上,你不知道(dào)這(zhè)件事(shì)需要多長(cháng)時間才能(néng)有好(hǎo)轉;你能(néng)确定的是,人們會在中短期内遭受巨大的痛苦和折磨。

我不太相信 AI 會因爲可能(néng)制定自己的目标并阻止我們關閉它而對(duì)人類産生威脅的說法。然而,我确實認爲 AI 是危險的,因爲它增加了一些人的權力。

末日情景并不是像一個著名的思想實驗所想象的那樣(yàng),一個 AI 將(jiāng)整個地球“變成(chéng)回形針”,而是由 AI 強化的企業在追求股東利益的過(guò)程中對(duì)社會造成(chéng)危害。

批評新技術的人有時被(bèi)稱爲盧德派(Luddites),他們抗議的主要内容是,在食品價格增加、工廠主利潤增加的同時,他們的工資卻在下降。他們還(hái)抗議不安全的工作條件,以及銷售有損整個紡織業信譽的劣質商品。

盧德派并非不加選擇地破壞機器,如果他們從工廠主那裡(lǐ)獲得了很高的工資,就不會去破壞它。他們也不反對(duì)新技術,他們想要的是經(jīng)濟上的公正。他們破壞機器是爲了引起(qǐ)工廠主的注意。如今,“盧德派”一詞被(bèi)用作侮辱他人、指責其不理性和無知,他們被(bèi)惡意抹黑了。

每當看到有人指責别人是盧德派時,我們需要認真思考:被(bèi)指責的人真的反對(duì)技術嗎?指責他人的人真的認爲新技術可以改善人們的生活嗎?還(hái)是說,他們隻是試圖增加私人資本的積累呢?

今天,我們發(fā)現自己處于這(zhè)樣(yàng)一種(zhǒng)情況中:技術與資本/金錢混淆在一起(qǐ),而資本/金錢又與進(jìn)步的概念混淆在一起(qǐ)。如果你試圖批評他們,就會被(bèi)指責反對(duì)技術和進(jìn)步。但是,如果進(jìn)步不包括改善工人的生活,那它的意義到底是什麼(me)呢?如果節省下來的錢隻是流向(xiàng)股東的銀行賬戶,那提高效率又有什麼(me)意義呢?

我們都(dōu)應該努力成(chéng)爲盧德派,因爲我們應該更關心經(jīng)濟上的公正,而不是私人資本的增加。我們希望能(néng)夠批評技術的有害使用方式,如有益于股東而有害于工人的方式,而不是被(bèi)描述爲技術的反對(duì)者。

一個理想化的未來是,在一百年後(hòu),沒(méi)有人會被(bèi)迫從事(shì)他們不喜歡的工作,每個人都(dōu)可以用自己認爲的最有成(chéng)就感的方式度過(guò)一生。顯然,我們還(hái)不知道(dào)如何從當前走向(xiàng)那個理想化的未來。

然而,在未來幾十年内,可能(néng)會出現兩(liǎng)種(zhǒng)情況:一種(zhǒng)是,管理和資本力量比現在更加強大;另一種(zhǒng)是,勞動力比現在更加強大。哪一種(zhǒng)情況更有可能(néng)讓我們更接近那個理想化的未來?而就當前的情況而言,AI 在幫助我們朝著(zhe)哪個方向(xiàng)前進(jìn)?

當然,有一種(zhǒng)說法是,從長(cháng)遠來看,新技術提高了我們的生活水平,彌補了它在短期内造成(chéng)失業的負面(miàn)影響。這(zhè)一說法在工業革命後(hòu)的大部分時期内都(dōu)很有說服力,但在過(guò)去的半個世紀中,就不太令人信服了

在美國(guó),人均 GDP 自 1980 年以來幾乎翻了一倍,而家庭收入的中位數卻沒(méi)有跟上這(zhè)一增長(cháng)趨勢。而這(zhè)一時期正好(hǎo)發(fā)生了信息技術革命。這(zhè)意味著(zhe)個人電腦和互聯網創造的經(jīng)濟價值大多流向(xiàng)了最頂層的富人群體,而并非提高美國(guó)公民的整體生活水平。

當然,如今有數以億計的人都(dōu)能(néng)夠使用互聯網,而且這(zhè)一技術确實令人驚歎。但房地産價格、大學(xué)學(xué)費和醫療保健費用的增長(cháng)速度卻超過(guò)了通貨膨脹。在 1980 年,一個家庭靠一份收入來養家糊口是很常見的,而現在已經(jīng)很少見了。那麼(me),在過(guò)去的四十年裡(lǐ),我們到底取得了多大的進(jìn)步?

當然,網上購物快捷方便,在家中觀看流媒體電影也很酷,但我認爲很多人願意爲了擁有自己的房子、送孩子上大學(xué)而不欠下終身債務,去醫院看病而不陷入破産危機而放棄這(zhè)些便利。

收入中位數沒(méi)有跟上人均 GDP 的增長(cháng)速度,不是技術的錯,而是 Milton Friedman 等人的錯,以及像前通用電氣首席執行官 Jack Welch 等人和麥肯錫這(zhè)樣(yàng)的咨詢公司的管理政策。

我并非把财富不平等的加劇歸咎于個人電腦的産生,我隻是說,“更好(hǎo)的技術必然會提高人們的生活水平” 的說法已不再令人信服。

在讨論 AI 可能(néng)帶來的好(hǎo)處時,個人電腦沒(méi)有提高收入中位數這(zhè)一事(shì)實尤爲重要。人們經(jīng)常建議,研究人員應該專注于 AI 如何提高個體工人的生産力,而不是取代他們;這(zhè)被(bèi)稱爲增強路徑,而不是自動化路徑。這(zhè)是一個值得追求的目标,但僅憑此目标并不能(néng)改善人們的經(jīng)濟狀況。

一個在個人電腦上運行的生産力軟件是增強而非自動化的典型例子是:文字處理程序取代了打字機而不是打字員,電子表格程序取代了紙質電子表格而不是會計師。但是,個人電腦所帶來的個人生産力的提高并沒(méi)有與生活水平的提高相匹配。

技術能(néng)夠提高生活水平的唯一途徑是,有适當的經(jīng)濟政策來分配技術的好(hǎo)處。在過(guò)去的四十年中,我們沒(méi)有這(zhè)些政策,除非我們能(néng)夠得到這(zhè)些政策,否則沒(méi)有理由認爲即將(jiāng)到來的 AI 進(jìn)步將(jiāng)提高收入中位數,即使我們能(néng)夠爲它設計出增強個體工人能(néng)力的方法。AI 肯定會降低勞動力成(chéng)本,增加企業的利潤,但這(zhè)與改善我們的生活水平完全不同。

假設一個烏托邦式的未來就在眼前,而且我們已經(jīng)開(kāi)發(fā)出了在那個未來使用的技術。但是,某項技術在烏托邦中有用并不意味著(zhe)它現在就有用。在一個能(néng)將(jiāng)有毒廢物轉化爲食物的烏托邦中,産生有毒廢物將(jiāng)不再是一個環境問題,但在當下,沒(méi)有人可以說産生有毒廢物是無害的。

一些人可能(néng)會說,産生更多的有毒廢物將(jiāng)加速廢物轉化爲食物的發(fā)明的誕生,但這(zhè)一觀點有多大的說服力呢?我們在評估技術的環境影響時,要考慮當前可用的減緩措施,而不是未來的減緩措施。

同樣(yàng)地,我們不能(néng)通過(guò)想象 AI 在全民基本收入普及的世界中會有多大幫助來評估它;我們必須根據資本與勞動之間現存的不平衡來評估它,在這(zhè)種(zhǒng)情況下,AI 是一種(zhǒng)威脅,因爲它成(chéng)爲了 “資本的順從執行者”。

一位前麥肯錫合夥人爲該公司的行動辯護說:“我們不參與政策制定,我們隻負責執行。”但這(zhè)是一個顯得十分蒼白的借口;當咨詢公司或新技術提供執行方法時,更有可能(néng)做出有害的政策決定。

當前正在開(kāi)發(fā)的一些 AI 系統會讓公司有更多的裁員,有沒(méi)有可能(néng)開(kāi)發(fā)一種(zhǒng)使裁員變得更困難的 AI 呢?要麼(me)增加政府監管,要麼(me)賦予工會或工人更多權力。

1976 年,英國(guó)伯明翰的 Lucas Aerospace 公司的工人面(miàn)臨因國(guó)防開(kāi)支削減而被(bèi)解雇的困境。作爲回應,車間工會代表們制定了一份被(bèi)稱爲“Lucas Plan”的文件,描述了透析機、風力渦輪機和混合動力汽車發(fā)動機等 150 種(zhǒng)“對(duì)社會有用的産品”,這(zhè)些産品可以利用那時的技能(néng)和設備由工人來生産。盡管 Lucas Aerospace 的管理層最終拒絕了這(zhè)個提議,但它仍然是一個工人試圖將(jiāng)資本主義引向(xiàng)更人性化方向(xiàng)的著名案例。當然,類似的事(shì)情在現代計算技術中也一定是可能(néng)的。

作爲個人,你能(néng)做些什麼(me)?如果你在 Frito-Lay 公司擔任食品科學(xué)家,而你的工作任務是發(fā)明新口味的土豆片,我不會說你有道(dào)德義務辭職,因爲你在推動消費主義。你在運用作爲食品科學(xué)家的專業知識爲顧客提供愉悅的體驗,這(zhè)是一種(zhǒng)完全合理的謀生方式。

但是,許多從事(shì) AI 工作的人認爲,AI 比發(fā)明新薯片口味更重要。他們稱其爲一項能(néng)夠改變世界的技術。如果是這(zhè)樣(yàng),那麼(me)他們有責任找到讓 AI 在不先讓世界變得更糟的情況下改善世界的方法。除了將(jiāng)我們推向(xiàng)社會崩潰的邊緣,AI 可以改善我們世界的不公平現象嗎?如果 AI 像其支持者聲稱的那樣(yàng)是一個強大的工具,除了加劇資本聚集之外,他們應該能(néng)夠找到其他用途。

如果說我們應該從有關精靈的童話故事(shì)中吸取什麼(me)教訓的話,那就是不努力就想得到某些東西的願望才是真正的問題。

想想《魔法師的學(xué)徒》的故事(shì),學(xué)徒施法讓掃帚運水,但無法讓它們停下來。這(zhè)個故事(shì)的教訓并不是說魔法是無法控制的:在故事(shì)的結尾,巫師回來後(hòu)立即擺平了學(xué)徒所造成(chéng)的混亂。真正的教訓是,你不能(néng)逃避做艱苦的工作。學(xué)徒想逃避他的雜務,而尋找捷徑就是讓他陷入困境的原因。

將(jiāng) AI 視爲一個“神奇的問題解決者”的傾向(xiàng)表明,人們想要逃避建設一個更好(hǎo)的世界所需的艱苦工作。這(zhè)項艱苦的工作將(jiāng)涉及解決财富不平等和馴服資本主義等問題。

對(duì)于技術專家來說,最艱難的工作——他們最想避免的任務——將(jiāng)是質疑更多的技術總是更好(hǎo)的假設,以及他們可以繼續照常工作,一切都(dōu)會自行解決的信念。

沒(méi)有人喜歡思考自己在世界不公正中的責任,但對(duì)于那些正在構建颠覆性技術的人們來說,進(jìn)行這(zhè)種(zhǒng)關鍵的自我審視是必要的。他們是否願意堅定地審視自己在系統中的角色,將(jiāng)決定 AI 是催生一個更好(hǎo)的世界,還(hái)是一個更壞的世界。

标簽: AI

版權申明:本站文章部分自網絡,如有侵權,請聯系:hezuo@lyzg168.com

特别注意:本站所有轉載文章言論不代表本站觀點,本站所提供的攝影照片,插畫,設計作品,如需使用,請與原作者聯系,版權歸原作者所有

輸入您的聯系信息,我們將(jiāng)盡快和你取得聯系!

Tel:15137991270

企業QQ:210603461

Emile:hezuo@lyzg168.com

地址:洛陽市西工區王城大道(dào)221号富雅東方B座1711室

網站:https://www.lyzg168.com

我們的微信

關注兆光,了解我們的服務與最新資訊。

Copyright © 2018-2019 洛陽霆雲網絡科技有限公司