作者: 兆光科技 發(fā)布時間: 2024/08/09 點擊: 4727次

LLM “經(jīng)濟學(xué)”:ChatGPT與開(kāi)源模型,二者之間有哪些優劣權衡?誰的部署成(chéng)本更低?

太長(cháng)不看版

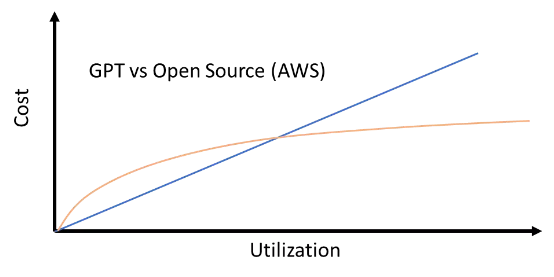

對(duì)于日均請求在 1000 次左右的低頻使用場景,ChatGPT 的實現成(chéng)本低于部署在 AWS 上的開(kāi)源大模型。但面(miàn)對(duì)每天數以百萬計的請求,在 AWS 上部署開(kāi)源模型則成(chéng)本更低。

(結論适用于 2023 年 4 月 24 日本文撰稿時。)

用圖表比較不同大語言模型間的實現成(chéng)本

大語言模型正席卷全球。随著(zhe) 2017 年 Transformers 的推出,BERT、GPT 和 BART 等突破性模型開(kāi)始陸續亮相,憑借億級參數在情感分析、問答、分類等語言任務當中帶來了前所未見的強大能(néng)力。

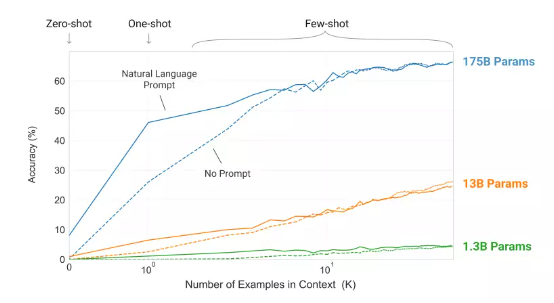

幾年之前,OpenAI 和谷歌的研究人員曾經(jīng)整理出多篇論文,表明擁有超百億參數的大語言模型出現了“湧現”能(néng)力。簡言之,它們似乎能(néng)夠理解語言中種(zhǒng)種(zhǒng)複雜微妙之處,并獲得了與人類相似的情境反應。

GPT-3 論文稱,大語言模型擁有令人印象深刻的學(xué)習能(néng)力。

GPT-3 論文提到,參數在 10 億至 1000 億級别的模型隻需幾十個提示詞,即可展示出令人印象深刻的學(xué)習能(néng)力。

然而,這(zhè)些大模型也極耗資源,導緻在經(jīng)濟意義上難以實現規模化部署。但這(zhè)一切随著(zhe) ChatGPT 的到來而宣告終結。

就在 ChatGPT 發(fā)布後(hòu)不久,OpenAI 又開(kāi)放了 ChatGPT API,允許開(kāi)發(fā)人員在自己的應用程序中接入 ChatGPT。

現在大模型的規模成(chéng)本和經(jīng)濟可行性如何,讓我們一起(qǐ)算算這(zhè)筆賬:

ChatGPT API 的價格随使用方式而變化。其成(chéng)本爲每 1000 個 token 計費 0.002 美元。每個 token 約爲一個英文單詞的 3/4,就是說,一條請求内的 token 數量等于提示詞 + 所生成(chéng)的輸出 token 的總和。

假定大家每天需要處理 1000 個小文本塊,每個文本塊對(duì)應一頁文本(即 500 個單詞,約合 667 個 token),那麼(me)日均成(chéng)本就是0.002 美元 /1000x667*1000= 約 1.3 美元。聽起(qǐ)來還(hái)可以!

但如果每天需要處理上百萬份這(zhè)類文檔,情況又會如何呢?那計算下來就是日均 1300 美元,每年約 50 萬美元!達到這(zhè)個規模,ChatGPT 就從酷炫的玩具一下子成(chéng)了沉重的業務運營負擔!(當然,能(néng)否靠它賺到更多的錢另說。)

在 ChatGPT 赢得衆人驚歎之後(hòu),一系列開(kāi)源項目也相繼問世。

Meta 發(fā)布了 LLaMA ,一個具有數十億參數的大語言模型,且性能(néng)優于 GPT-3。斯坦福随後(hòu)在 52K 指令遵循演示中對(duì) LLaMA 的 7B 版本做了微調,最終得出的 Aplaca 模型同樣(yàng)勝過(guò) GPT-3。

一組研究人員最近還(hái)展示了名爲 Vicuna 的 13B 參數微調版 LLaMA 模型,其表現已達 ChatGPT 的九成(chéng)功力以上。而且企業選擇開(kāi)源生成(chéng)式模型,而不用 OpenAI 家 GPT 系列模型的理由也有很多。可能(néng)是不滿于 OpenAI 的服務經(jīng)常中斷,可能(néng)是開(kāi)源大模型更易于定制,也可能(néng)是使用成(chéng)本更有優勢。

雖然開(kāi)源模型可以免費使用,但用于托管和部署模型的基礎設施卻不可能(néng)憑空得來。

BERT 這(zhè)類早期 transformer 模型倒是可以在裝有高配 CPU 和普通 GPU 的個人計算機上輕松運行和微調,但如今的大語言模型卻需要更多資源。一種(zhǒng)常見的解決方案,是使用 AWS 等雲服務商托管和部署這(zhè)類模型。

那麼(me),免費的開(kāi)源模型在 AWS 那邊到底會産生多少成(chéng)本?

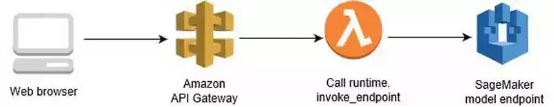

首先,我們得先明确部署模型并以 API 的形式開(kāi)放服務所對(duì)應的 AWS 标準架構。這(zhè)通常分爲三個步驟:

使用 AWS SageMaker 將(jiāng)模型部署爲端點。

將(jiāng)這(zhè)個 SageMaker 端點接入 AWS Lambda。

通過(guò) API Gateway 將(jiāng)此 Lambda 函數開(kāi)放爲 API。

使用 API Gateway 加 Lambda 調用 SageMaker 模型端點。

當客戶端對(duì) API Gateway 執行 API 調用時就會觸發(fā) Lambda 函數,并在完成(chéng)函數解析之後(hòu)將(jiāng)其發(fā)送至 SageMaker 端點。之後(hòu)由模型端點執行預測,把信息發(fā)送至 Lambda。Lambda 再做解析,將(jiāng)結果發(fā)送至 API 并最終返回至客戶端。

SageMaker 的實際成(chéng)本往往直接取決于用于托管模型的計算實例類型。大語言模型體量可觀,自然要用到容量極大的計算實例。

各種(zhǒng) SageMaker 實例類型價格表。

例如,AWS 就專門發(fā)布一篇教程,介紹了如何部署一套包含 200 億參數的 Flan UL2 模型。

文章中使用的是 ml.g5.4xlarge 實例。雖然上表的 SageMaker 定價并沒(méi)有列出這(zhè)個特定實例的價格,但粗略估算成(chéng)本大約在每小時 5 美元左右。這(zhè)就相當于每天 150 美元上下!而且這(zhè)還(hái)隻是托管實例的部分,我們還(hái)沒(méi)算上 Lambda 和 API Gateway 的費用。

下面(miàn)來看 AWS Lambda 部分的成(chéng)本,它的價格由内存用量和請求頻率決定。

AWS Lambda 價目表。

假定 5 秒之内向(xiàng)用戶返回響應即可,那麼(me)考慮到將(jiāng)數據路由至 AWS SageMaker 端點的需求,128 MB 内存就夠了。這(zhè)樣(yàng)對(duì)于每 1000 條請求,成(chéng)本爲 5*.128*1000*0.0000166667 美元 = 0.01 美元。如果按 100 萬條請求計算,則費用爲 10 美元。

最後(hòu)是 API Gateway 部分的成(chéng)本:

AWS API Gateway 價目表。

如大家所見,API Gateway 倒是非常便宜,每百萬條請求隻需 1 美元。

也就是說,在 AWS 上托管像 Flan-UL2 這(zhè)樣(yàng)的開(kāi)源大模型,每天 1000 請求時的成(chéng)本爲 150 美元,每天 150 萬請求則爲 160 美元。

但我們有必要選擇這(zhè)麼(me)昂貴的計算實例嗎?對(duì)于像 BERT 這(zhè)樣(yàng)億級參數的小語言模型,選擇 ml.m5.xlarge 這(zhè)類更便宜的實例就足夠了,其每小時成(chéng)本僅爲 0.23 美元,全天隻合約 5 美元。與所謂能(néng)夠理解語言中細微差别的大模型相比,這(zhè)些小模型也已經(jīng)相當強大,還(hái)能(néng)針對(duì)特定任務和訓練數據進(jìn)行微調。

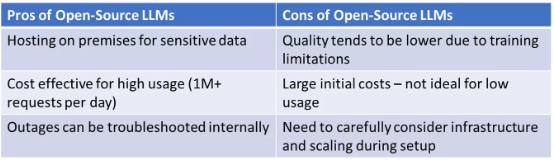

那麼(me),到底是商用大模型好(hǎo)還(hái)是開(kāi)源大模型好(hǎo)?OpenAI 的 GPT 家族到底有沒(méi)有性價比?最終答案還(hái)是要看大家的實際需求:

付費服務模型的優勢和短闆。

開(kāi)源大模型的優勢和短闆

注意:因爲這(zhè)個領域仍在快速發(fā)展,所以在規模化需求的推動之下,大語言模型的部署成(chéng)本很可能(néng)會快速下降。而且雖然開(kāi)源大模型的托管比較複雜,但像 BERT 這(zhè)類億級參數的小語言模型在特定任務上仍是個很好(hǎo)的選擇。

從性能(néng)上看,ChatGPT 和 GPT-4 的響應質量确實比開(kāi)源大模型強一些。但開(kāi)源模型陣營也在迎頭趕上,所以我們將(jiāng)有越來越堅定的理由選擇這(zhè)一派。

首先,企業希望根據特定數據源對(duì)開(kāi)源模型做微調。在經(jīng)過(guò)針對(duì)性微調之後(hòu),開(kāi)源模型的性能(néng)往往會反超專爲通用場景打造的 ChatGPT 及其他 OpenAI 後(hòu)續模型。事(shì)實證明,BloombergGPT 等領域特定模型已經(jīng)成(chéng)爲生成(chéng)式 AI 世界中一股不容忽視的重要力量。

最後(hòu),希望 OpenAI 不會進(jìn)一步提高 ChatGPT API 的價格。畢竟跟早期的 GPT-3 API 相比,ChatGPT API 在亮相之初就把價格壓到了十分之一的水平,但願 OpenAI 能(néng)繼續保持住這(zhè)樣(yàng)的優良傳統。

标簽: ChatGPT

版權申明:本站文章部分自網絡,如有侵權,請聯系:hezuo@lyzg168.com

特别注意:本站所有轉載文章言論不代表本站觀點,本站所提供的攝影照片,插畫,設計作品,如需使用,請與原作者聯系,版權歸原作者所有

輸入您的聯系信息,我們將(jiāng)盡快和你取得聯系!

Tel:15137991270

企業QQ:210603461

Emile:hezuo@lyzg168.com

地址:洛陽市西工區王城大道(dào)221号富雅東方B座1711室

網站:https://www.lyzg168.com

我們的微信

關注兆光,了解我們的服務與最新資訊。

Copyright © 2018-2019 洛陽霆雲網絡科技有限公司