作者: 兆光科技 發(fā)布時間: 2024/08/10 點擊: 1110次

OpenAI硬核研究:用GPT-4打開(kāi)GPT-2“大腦”。

智東西5月10日報道(dào),今天,OpenAI官方博客發(fā)布新的研究進(jìn)展,研究人員正在使用GPT-4來自動解釋GPT-2的行爲。

當下大型語言模型正在紮堆發(fā)布,但對(duì)于它背後(hòu)的思考過(guò)程我們知之甚少。而今天,OpenAI正在打開(kāi)大型語言模型的思考“黑盒”,讓AI被(bèi)自己解釋!

這(zhè)一技術的具體實現方式是,研究人員先給定GPT-2一個主題,并讓其生成(chéng)文本序列,再用GPT-4解釋GPT-2生成(chéng)的内容,再通過(guò)GPT-4模拟GPT-2的下一步操作,最後(hòu)將(jiāng)GPT-4模拟生成(chéng)的和GPT-2實際生成(chéng)的内容進(jìn)行對(duì)比評分。

目前,OpenAI已經(jīng)通過(guò)GPT-4對(duì)GPT-2中307200個神經(jīng)元進(jìn)行了書面(miàn)解釋,從結果來看,絕大多數的解釋評分并不高,超過(guò)1000個神經(jīng)元的解釋得分高于0.8,不過(guò)研發(fā)人員稱,這(zhè)一結果意味著(zhe)基于GPT-4,他們已經(jīng)解釋了神經(jīng)元的大部分激活行爲。

雖然目前從結果來看,OpenAI通過(guò)GPT-4解釋GPT-2的效果并不完美,但這(zhè)一階段性的成(chéng)果給AI可解釋性研究提供了思路,這(zhè)一方法會随著(zhe)AI的發(fā)展而不斷精進(jìn)。

此外,OpenAI正在開(kāi)源其307200個神經(jīng)元的書面(miàn)解釋的數據集和可視化工具,以及使用OpenAI API上公開(kāi)可用的模型進(jìn)行解釋和評分的代碼。

論文地址:

https://openaipublic.blob.core.windows.net/neuron-explainer/paper/index.html

神經(jīng)元查看器:

https://openaipublic.blob.core.windows.net/neuron-explainer/neuron-viewer/index.html

GitHub開(kāi)源地址:

https://github.com/openai/automated-interpretability

OpenAI解釋神經(jīng)元的過(guò)程使用了三種(zhǒng)算法,分别是能(néng)顯示神經(jīng)元對(duì)文本摘錄響應的解釋器模型Explain、使用模拟器模型Simulate根據生成(chéng)文本解釋模拟神經(jīng)元激活、Score算法對(duì)模拟激活内容與真實激活内容的匹配程度進(jìn)行評分。

在測試過(guò)程中,研究人員使用GPT-2預訓練模型作爲被(bèi)解釋的模型,使用GPT-4作爲解釋器和模拟器模型。

研究人員選擇不同的文檔來生成(chéng)解釋和模拟,這(zhè)一方法包括在每個神經(jīng)元上運行下面(miàn)3個步驟:

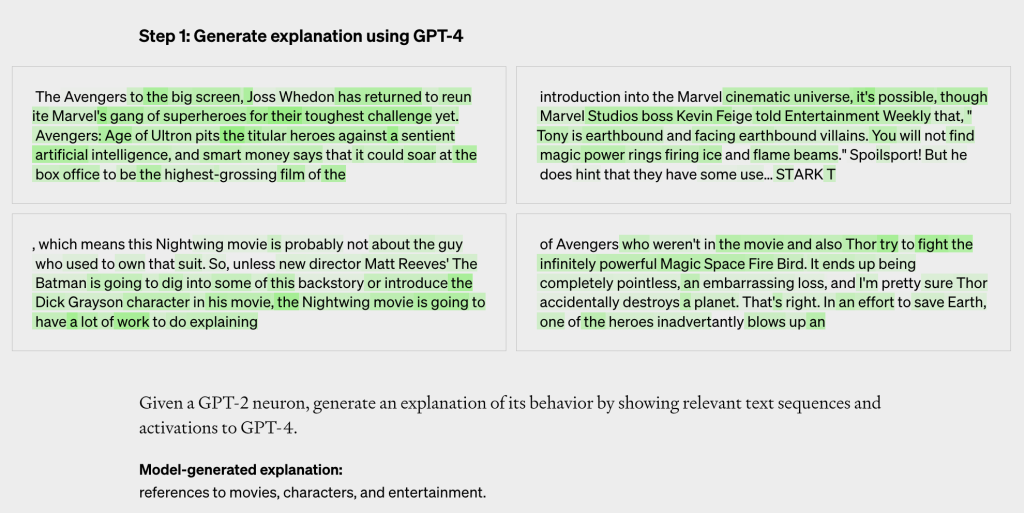

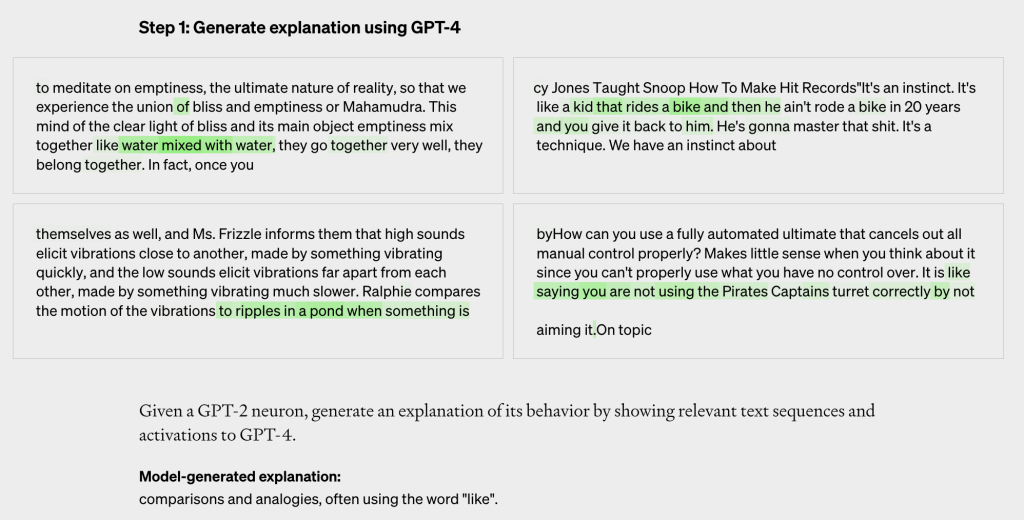

首先,先給定GPT-2一個主題去生成(chéng)文本,然後(hòu)使用GPT-4來生成(chéng)對(duì)GPT-2生成(chéng)文本序列的行爲解釋。

如,當GPT-2生成(chéng)“漫威漫畫(Marvel comics vibes)”相關内容時,GPT-4生成(chéng)的解釋是其文本中有“對(duì)電影、角色和娛樂的引用”。給定主題是“明喻(similes)”時,GPT-4生成(chéng)的解釋是“比較和類比,常用‘like(類似)’這(zhè)個詞”。

▲測試案例:上圖主題是“漫威漫畫(Marvel comics vibes)”、下圖主題是“明喻(similes)

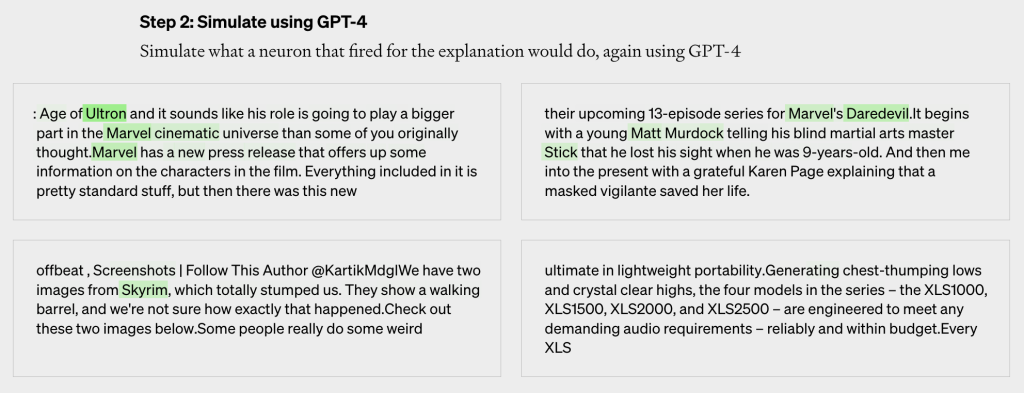

第二步,使用GPT-4模拟神經(jīng)元的行爲。這(zhè)一步驟想要回答的問題是,假設GPT-4的解釋準确而全面(miàn)地解釋了神經(jīng)元的行爲,那麼(me)該神經(jīng)元將(jiāng)如何針對(duì)特定序列中的每個标記激活。

剛開(kāi)始,研究人員使用了“一次一個(one at a time)”方法,提供給GPT-4的提示由一些小樣(yàng)本和預測單個神經(jīng)元激活的單樣(yàng)本示例組成(chéng),但這(zhè)種(zhǒng)方法速度較慢。随後(hòu),研究人員使用少量示例并行化了所有标記的概率預測,使得激活值變爲文本序列中随機位置的實際值,他們將(jiāng)這(zhè)種(zhǒng)方法稱爲“一次全部(all at once)”。

經(jīng)驗證,這(zhè)種(zhǒng)研究方法在預測人類偏好(hǎo)方面(miàn),與速度較慢的“一次一個”方法效果類似。

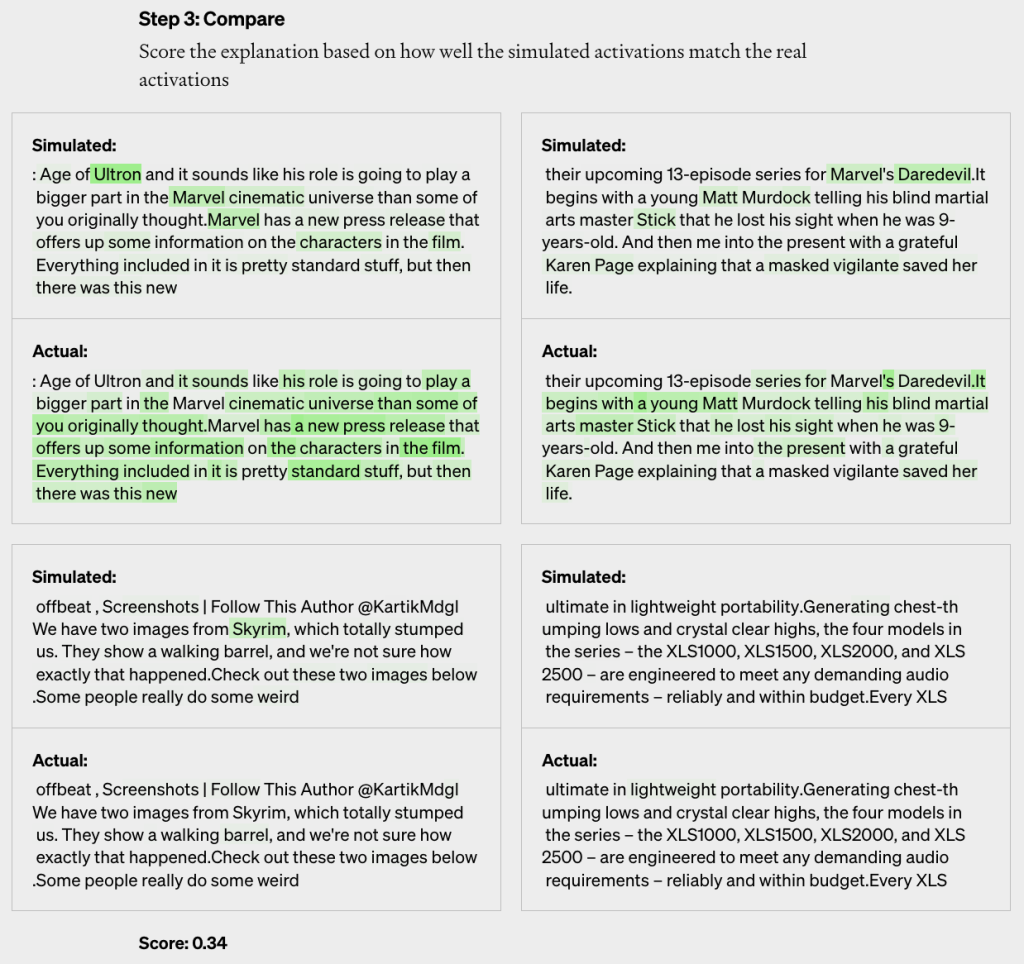

第三步,將(jiāng)GPT-4模拟的内容與GPT-2真實生成(chéng)的内容進(jìn)行對(duì)比,根據其匹配程度進(jìn)行評分。

研究人員采用的主要評分方法是相關性評分,如果模拟神經(jīng)元的行爲與真實神經(jīng)元相同,則得分爲1。如果模拟神經(jīng)元的行爲是随機的,當解釋與神經(jīng)元行爲無關得分將(jiāng)趨向(xiàng)于0。

不過(guò),基于模拟的評分實際上并不能(néng)反映人類對(duì)解釋的準确評估。因此他們收集了人類對(duì)GPT-4生成(chéng)解釋質量的評估,并與模拟生成(chéng)的評分結果相比較。

結果表明,人類往往更喜歡得分較高的解釋而不是得分較低的解釋,随著(zhe)得分差距的擴大,這(zhè)種(zhǒng)現象的發(fā)展趨勢也會更加明顯。

從整體評分結果來看,OpenAI測驗生成(chéng)的絕大部分解釋得分都(dōu)較低。不過(guò)同時,研究人員也發(fā)現了一些GPT-4不理解的有趣神經(jīng)元。

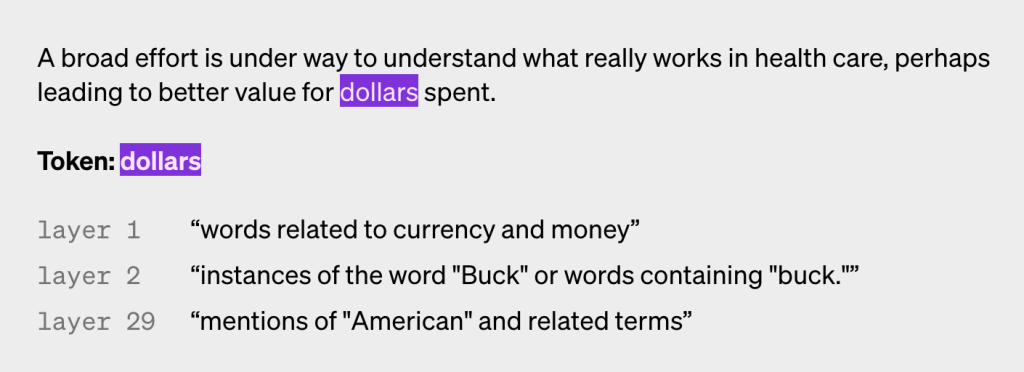

如“dollars”的意思,第一層理解爲“與貨币和金錢有關的詞”;第二層爲“‘buck(美元)’一詞或包含‘buck(美元)’的實例”;第29層爲“提及‘美國(guó)’及相關術語”。

因此,研究人員希望随著(zhe)解釋的改進(jìn),能(néng)夠快速理解這(zhè)些大型語言模型生成(chéng)的有趣内容。研發(fā)人員認爲,他們可以使用機器學(xué)習技術來進(jìn)一步提高GPT-4解釋的能(néng)力。

以下幾種(zhǒng)方法可以幫助提高評分結果:

1、叠代解釋(Iterating on explanations)。研發(fā)人員通過(guò)要求GPT-4提出可能(néng)的相反案例,然後(hòu)根據它們的激活結果修改解釋來提高分數。

2、使用更大的語言模型來給出解釋(Using larger models to give explanations)。随著(zhe)解釋器模型能(néng)力的提高,平均分數也會上升。然而,即使是GPT-4這(zhè)樣(yàng)參數規模的大型語言模型也給出了比人類更差的解釋,這(zhè)表明還(hái)有改進(jìn)的餘地。

3、更改已解釋模型的架構(Changing the architecture of the explained model)。具有不同激活函數的訓練模型提高了解釋分數。

因此基于上述考慮,OpenAI開(kāi)源了數據集,他們希望研究界能(néng)夠開(kāi)發(fā)新技術來生成(chéng)更高分的解釋,并開(kāi)發(fā)更好(hǎo)的工具來解釋GPT-2。

目前,OpenAI用于解釋GPT-2的方法還(hái)有很多局限性:

研究人員希望GPT-4生成(chéng)的解釋是簡短的自然語言,但神經(jīng)元可能(néng)具有非常複雜的行爲,無法被(bèi)簡潔清晰的叙述出來。例如,神經(jīng)元可以代表許多不同的概念,或者可以代表人類不理解或無法用語言表達的單一概念。

他們希望最終自動找到并解釋實現複雜行爲的整個神經(jīng)回路,使得神經(jīng)元和注意力中樞協同工作。OpenAI當前的方法僅將(jiāng)神經(jīng)元行爲解釋爲原始文本輸入的函數,而沒(méi)有說明其接下來産生的影響。例如,當神經(jīng)元激活的位置是一個句号,這(zhè)可以指向(xiàng)後(hòu)面(miàn)的英文單詞應該大寫開(kāi)頭等。

這(zhè)一評分系統解釋了神經(jīng)元的行爲,但沒(méi)有試圖解釋産生這(zhè)種(zhǒng)行爲的機制。由于這(zhè)一方法更多描述的是測試文本上的相關性,因此模拟過(guò)程中獲得高分的解釋,對(duì)于測試外的文本解釋效果可能(néng)也很差。

最後(hòu),用GPT-4來解釋GPT-2的整個過(guò)程是計算密集型。

不過(guò),OpenAI的研究人員仍對(duì)這(zhè)一方法的推廣感到興奮。最終,他們希望使用大型語言模型來生成(chéng)、測試和叠代完全通用的預測。

大型語言模型在内容生成(chéng)、理解上的強大能(néng)力我們已經(jīng)有目共睹,但其内部的工作原理我們知之甚少,也很難從大型語言模型的最後(hòu)輸出結果中檢測到它們的“思考過(guò)程”是有偏見的或者是錯誤的。

盡管從結果看,OpenAI的研究方法還(hái)有很大的進(jìn)步空間,但這(zhè)一技術路線也爲AI的可解釋性研究提供了思路。

标簽: AI

版權申明:本站文章部分自網絡,如有侵權,請聯系:hezuo@lyzg168.com

特别注意:本站所有轉載文章言論不代表本站觀點,本站所提供的攝影照片,插畫,設計作品,如需使用,請與原作者聯系,版權歸原作者所有

輸入您的聯系信息,我們將(jiāng)盡快和你取得聯系!

Tel:15137991270

企業QQ:210603461

Emile:hezuo@lyzg168.com

地址:洛陽市西工區王城大道(dào)221号富雅東方B座1711室

網站:https://www.lyzg168.com

我們的微信

關注兆光,了解我們的服務與最新資訊。

Copyright © 2018-2019 洛陽霆雲網絡科技有限公司