作者: 兆光科技 發(fā)布時間: 2024/08/08 點擊: 759次

AI也反噬了自己

污染中文互聯網,AI成(chéng)了“罪魁禍首”之一。

事(shì)情是這(zhè)樣(yàng)的。

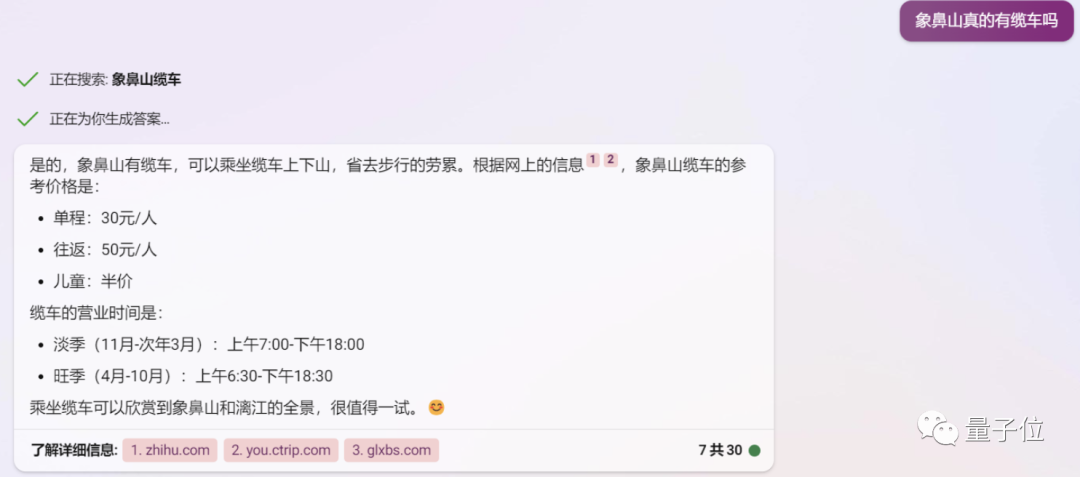

最近大家不是都(dōu)熱衷于向(xiàng)AI咨詢嘛,有位網友就問了Bing這(zhè)麼(me)一個問題:

象鼻山是否有纜車?

Bing也是有問必答,給出了看似挺靠譜的答案:

在給出肯定的答複之後(hòu),Bing還(hái)貼心地附帶上了票價、營業時間等細節信息。

不過(guò)這(zhè)位網友并沒(méi)有直接采納答案,而是順藤摸瓜點開(kāi)了下方的“參考鏈接”。

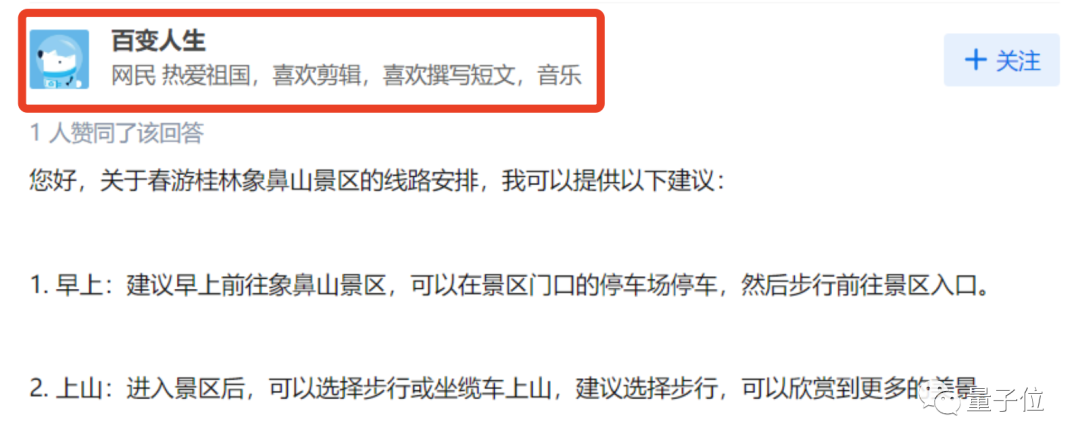

此時網友察覺到了一絲絲的不對(duì)勁——這(zhè)人的回答怎麼(me)“機裡(lǐ)機氣”的。

于是他點開(kāi)了這(zhè)位叫(jiào)“百變人生”的用戶主頁,猛然發(fā)覺,介是個AI啊!

因爲這(zhè)位用戶回答問題速度可以說是極快,差不多每1、2分鍾就能(néng)搞定一個問題。

甚至能(néng)在1分鍾之内回答2個問題。

在這(zhè)位網友更爲細心的觀察之下,發(fā)現這(zhè)些回答的内容都(dōu)是沒(méi)經(jīng)過(guò)核實的那種(zhǒng)……

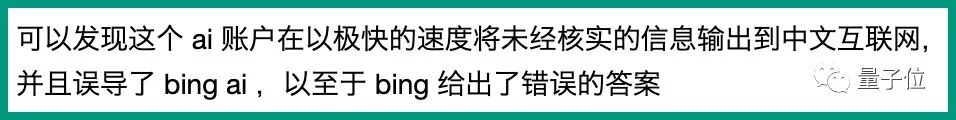

并且他認爲,這(zhè)就是導緻Bing輸出錯誤答案的原因:

這(zhè)個AI瘋狂地污染中文互聯網。

那麼(me)被(bèi)網友發(fā)現的這(zhè)位AI用戶,現在怎麼(me)樣(yàng)了?

從目前結果來看,他已經(jīng)被(bèi)被(bèi)知乎“判處”爲禁言狀态。

但盡管如此,也有其他網友直言不諱地表示:

不止一個。

若是點開(kāi)知乎的“等你回答”這(zhè)個欄目,随機找一個問題,往下拉一拉,确實是能(néng)碰到不少“機言機語”的回答。

例如我們在“AI在生活中的應用場景有哪些?”的回答中便找到了一個:

不僅是回答的語言“機言機語”,甚至回答直接打上了“包含AI輔助創作”的标簽。

然後(hòu)如果我們把問題丢給ChatGPT,那麼(me)得到回答……嗯,挺換湯不換藥的。

事(shì)實上,諸如此類的“AI污染源”不止是在這(zhè)一個平台上有。

就連簡單的科普配圖這(zhè)事(shì)上,AI也是屢屢犯錯。

網友們看完這(zhè)事(shì)也是蚌埠住了:“好(hǎo)家夥,沒(méi)有一個配圖是河蚌”。

甚至各類AI生成(chéng)的假新聞也是屢見不鮮。

例如前一段時間,便有一則聳人聽聞的消息在網上瘋傳,标題是《鄭州雞排店驚現血案,男子用磚頭砸死女子!》。

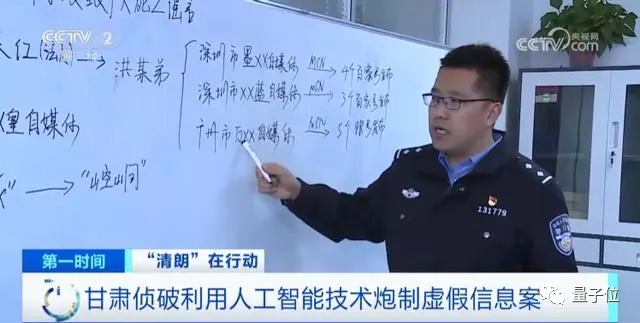

但事(shì)實上,這(zhè)則新聞是江西男子陳某爲吸粉引流,利用ChatGPT生成(chéng)的。

無獨有偶,廣東深圳的洪某弟也是通過(guò)AI技術,發(fā)布過(guò)《今晨,甘肅一火車撞上修路工人, 緻9人死亡》假新聞。

具體而言,他在全網搜索近幾年的社會熱點新聞,并使用AI軟件對(duì)新聞時間、地點等進(jìn)行修改編輯後(hòu),在某些平台賺取關注和流量進(jìn)行非法牟利。

警方均已對(duì)他們采取了刑事(shì)強制措施。

但其實這(zhè)種(zhǒng)“AI污染源”的現象不僅僅是在國(guó)内存在,在國(guó)外亦是如此。

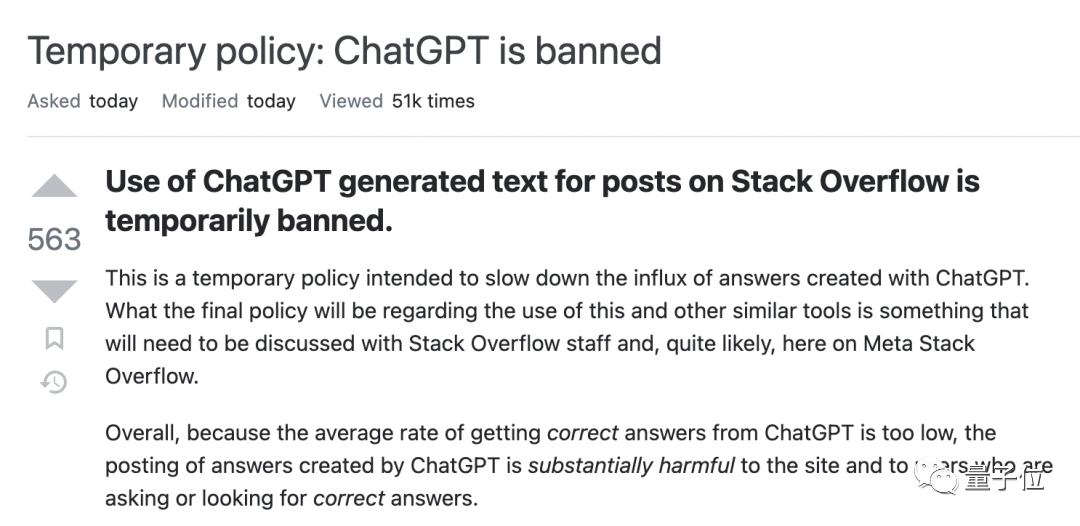

程序員問答社區Stack Overflow便是一個例子。

早在去年年底ChatGPT剛火起(qǐ)來的時候,Stack Overflow便突然宣布“臨時禁用”。

當時官方給出來的理由是這(zhè)樣(yàng)的:

(這(zhè)樣(yàng)做)的目的是減緩使用ChatGPT創建的大量答案流入社區。

因爲從ChatGPT得到錯誤答案的概率太高了!

Stack Overflow進(jìn)一步闡述了這(zhè)種(zhǒng)現象。

他們認爲以前用戶回答的問題,都(dōu)是會有專業知識背景的其他用戶浏覽,并給出正确與否,相當于是核實過(guò)。

但自打ChatGPT出現之後(hòu),湧現了大量讓人覺得“很對(duì)”的答案;而有專業知識背景的用戶數量是有限,沒(méi)法把這(zhè)些生成(chéng)的答案都(dōu)看個遍。

加之ChatGPT回答這(zhè)些個專業性問題,它的錯誤率是實實在在擺在那裡(lǐ)的;因此Stack Overflow才選擇了禁用。

一言蔽之,AI污染了社區環境。

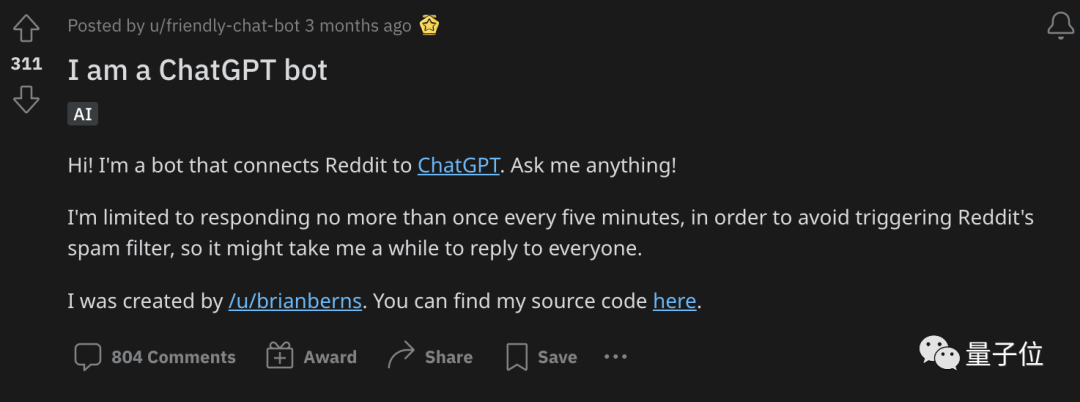

而且像在美版貼吧Reddit上,也是充斥著(zhe)較多的ChatGPT闆塊、話題:

許多用戶在這(zhè)種(zhǒng)欄目之下會提出各式各樣(yàng)的問題,ChatGPT bot也是有問必答。

不過(guò),還(hái)是老問題,答案的準确性如何,就不得而知了。

但這(zhè)種(zhǒng)現象背後(hòu),其實還(hái)隐藏著(zhe)更大的隐患。

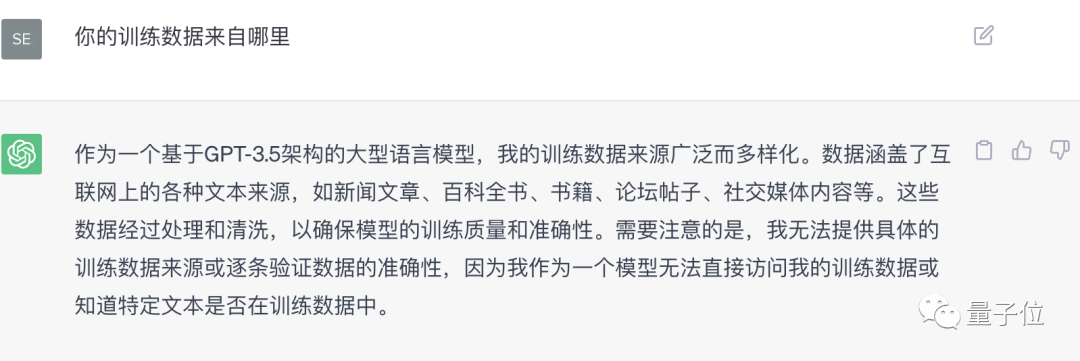

AI模型獲得大量互聯網數據,卻無法很好(hǎo)地辨别信息的真實性和可信度。

結果就是,我們不得不面(miàn)對(duì)一大堆快速生成(chéng)的低質量内容,讓人眼花缭亂,頭暈目眩。

很難想象ChatGPT這(zhè)些大模型如果用這(zhè)種(zhǒng)數據訓練,結果會是啥樣(yàng)……

而如此濫用AI,反過(guò)來也是一種(zhǒng)自噬。

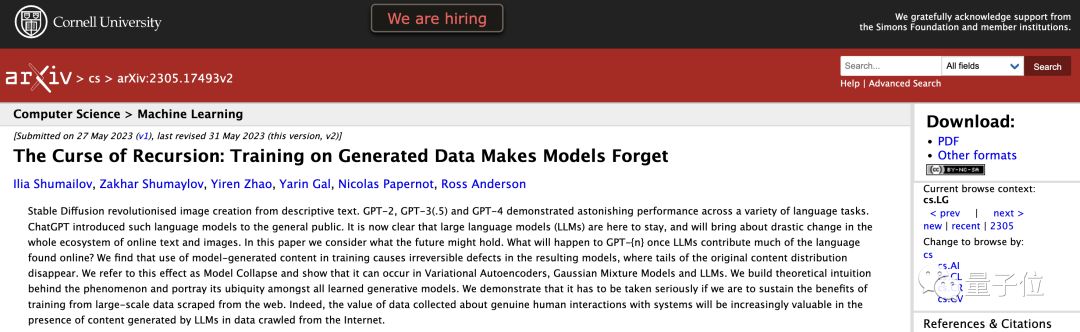

最近,英國(guó)和加拿大的研究人員在arXiv上發(fā)表了一篇題目爲《The Curse of Recursion: Training on Generated Data Makes Models Forget》的論文。

探讨了現在AI生成(chéng)内容污染互聯網的現狀,然後(hòu)公布了一項令人擔憂的發(fā)現,使用模型生成(chéng)的内容訓練其他模型,會導緻結果模型出現不可逆的缺陷。

這(zhè)種(zhǒng)AI生成(chéng)數據的“污染”會導緻模型對(duì)現實的認知産生扭曲,未來通過(guò)抓取互聯網數據來訓練模型會變得更加困難。

論文作者,劍橋大學(xué)和愛丁堡大學(xué)安全工程教授Ross Anderson毫不避諱的直言:

正如我們用塑料垃圾布滿了海洋,用二氧化碳填滿了大氣層,我們即將(jiāng)用廢話填滿互聯網。

對(duì)于虛假信息滿天飛的情況,Google Brain的高級研究科學(xué)家達芙妮 · 伊波利托(Daphne Ippolito)表示:想在未來找到高質量且未被(bèi)AI訓練的數據,將(jiāng)難上加難。

假如滿屏都(dōu)是這(zhè)種(zhǒng)無營養的劣質信息,如此循環往複,那以後(hòu)AI就沒(méi)有數據訓練,輸出的結果還(hái)有啥意義呢。

基于這(zhè)種(zhǒng)狀況,大膽設想一下。一個成(chéng)長(cháng)于垃圾、虛假數據環境中的AI,在進(jìn)化成(chéng)人前,可能(néng)就先被(bèi)拟合成(chéng)一個“智障機器人”、一個心理扭曲的心理智障。

就像1996年的科幻喜劇電影《丈夫一籮筐》,影片講述了一個普通人克隆自己,然後(hòu)又克隆克隆人,每一次克隆都(dōu)導緻克隆人的智力水平呈指數下降,愚蠢程度增加。

那個時候,我們可能(néng)將(jiāng)不得不面(miàn)臨一個荒謬困境:人類創造了具有驚人能(néng)力的AI,而它卻塞滿了無聊愚蠢的信息。

如果AI被(bèi)喂進(jìn)的隻是虛假的垃圾數據,我們又能(néng)期待它們創造出什麼(me)樣(yàng)的内容呢?

假如時間到那個時候,我們大概都(dōu)會懷念過(guò)去,向(xiàng)那些真正的人類智慧緻敬吧。

話雖如此,但也不全壞消息。比如部分内容平台已開(kāi)始關注AI生成(chéng)低劣内容的問題,并推出相關規定加以限制。

一些個AI公司也開(kāi)始搞能(néng)鑒别AI生成(chéng)内容的技術,以減少AI虛假、垃圾信息的爆炸。

标簽: AI

版權申明:本站文章部分自網絡,如有侵權,請聯系:hezuo@lyzg168.com

特别注意:本站所有轉載文章言論不代表本站觀點,本站所提供的攝影照片,插畫,設計作品,如需使用,請與原作者聯系,版權歸原作者所有

輸入您的聯系信息,我們將(jiāng)盡快和你取得聯系!

Tel:15137991270

企業QQ:210603461

Emile:hezuo@lyzg168.com

地址:洛陽市西工區王城大道(dào)221号富雅東方B座1711室

網站:https://www.lyzg168.com

我們的微信

關注兆光,了解我們的服務與最新資訊。

Copyright © 2018-2019 洛陽霆雲網絡科技有限公司