作者: 兆光科技 發(fā)布時間: 2024/08/09 點擊: 7968次

一覺醒來,整個科技圈驚掉了下巴!!!

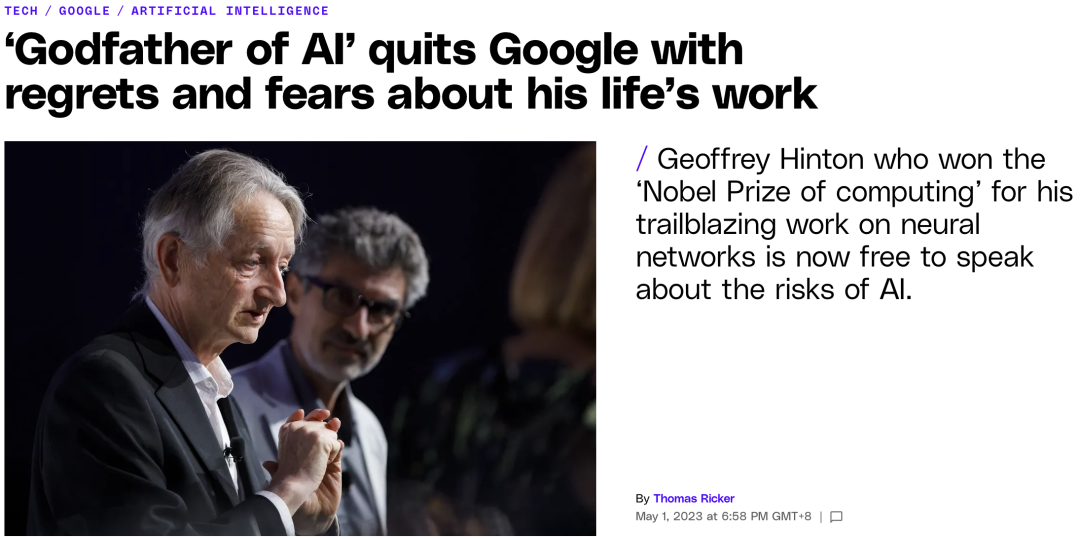

深度學(xué)習泰鬥、神經(jīng)網絡之父Geoffrey Hinton突然宣布離職谷歌。

爲了能(néng)夠自由談論人工智能(néng)風險,而不考慮這(zhè)對(duì)谷歌的影響。

紐約時報的報道(dào)中,Hinton直接警示世人:注意,前方有危險,前方有危險,前方有危險!

而正是對(duì)人工智能(néng)風險深深地擔憂,讓這(zhè)位深度學(xué)習巨佬直言:「我對(duì)自己的畢生工作,感到非常後(hòu)悔。」

如今,距離Hinton入職谷歌,剛好(hǎo)十年。

對(duì)于Hinton此舉,有人甚至勸說,應該將(jiāng)關注人工智能(néng)安全常态化,而不必辭去工作。

這(zhè)更應該是你留下來的理由。因爲世界是不會停止的,像你這(zhè)樣(yàng)的偉大人物應該堅持下去,并將(jiāng)人工智能(néng)發(fā)展的更好(hǎo)。

你應該勸說你的學(xué)生Yann LeCun和Ilya Sutskever。

值得一提的是,ChatGPT背後(hòu)真正的英雄正是OpenAI的聯合創始人兼首席科學(xué)家Ilya。

被(bèi)稱爲「人工智能(néng)教父」的Geoffrey Hinton,一直都(dōu)是該領域最受尊敬的先驅之一。

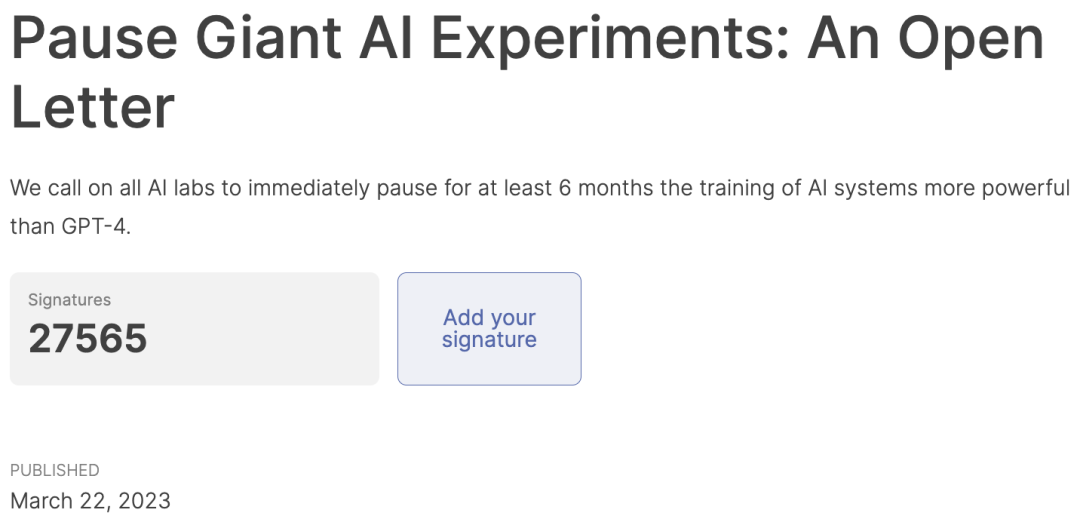

今年3月末,萬名大佬簽字發(fā)出聯名信,呼籲暫停訓練比GPT-4更強大的AI六個月。

圖靈三巨頭中,Bengio高調簽名、LeCun旗幟鮮明地反對(duì),唯有Hinton一言不發(fā),耐人尋味地保持沉默。

而Hinton提出離職的時間,正是在此之後(hòu)的4月份。

從他的推特上可以看出,無論是最近GPT-4等超強AI引發(fā)的巨大争議,還(hái)是谷歌高層的劇烈動蕩,Hinton都(dōu)始終保持緘默,不發(fā)一言。

許多人關注著(zhe)這(zhè)位人工智能(néng)教父的态度。

在CBS的一次采訪中,Hinton表示「我們幾乎已經(jīng)讓學(xué)會計算機如何自我改進(jìn)了,這(zhè)很危險,我們必須認真考慮,如何控制它。」

從人工智能(néng)的開(kāi)創者到末日預言者,Hinton的轉變,也标志著(zhe)科技行業正處于幾十年來最重要的一個拐點。

先驅的沉痛反思,讓我們終于不能(néng)再掩耳盜鈴,假裝沒(méi)有看見AI可能(néng)給人類社會引發(fā)的深刻改變和巨大危機了。

蓋茨等許多大佬認爲,ChatGPT可能(néng)與上世紀90年代初網絡浏覽器一樣(yàng)重要,并可能(néng)在藥物研究、教育等領域帶來突破。

與此同時,令許多業内人士不安的是,他們擔心自己所做的研究,正在向(xiàng)外釋放某種(zhǒng)危險。

因爲生成(chéng)式人工智能(néng)可能(néng)已經(jīng)成(chéng)爲産生錯誤信息的工具。并在未來的某個時候,可能(néng)會對(duì)人類構成(chéng)威脅。

在Hinton看來,如何防止壞人利用它做壞事(shì),我們還(hái)未能(néng)找到方法。

在3月底呼籲暫停超強AI六個月的公開(kāi)信發(fā)出幾天後(hòu),人工智能(néng)促進(jìn)協會的19位領導人也發(fā)布了公開(kāi)信,警告AI的風險。

其中就包括微軟的首席科學(xué)官Eric Horvitz,而微軟已在一系列産品中(包括Bing搜索引擎中)部署了OpenAI的GPT技術。

在喧嚣的反對(duì)浪潮中,人工智能(néng)教父Hinton卻并未在這(zhè)兩(liǎng)封信上簽名。

他說,自己在辭去工作之前,并不想公開(kāi)批評谷歌,或其他公司。

忍到上個月,Hinton終于下定決心,通知谷歌自己即將(jiāng)辭職。

選擇離職谷歌後(hòu),Hinton終于可以暢所欲言地談論AI的風險了。

我對(duì)我的畢生工作,感到十分後(hòu)悔。

我隻能(néng)這(zhè)樣(yàng)安慰自己:即使沒(méi)有我,也會有别人。

上周四,他與谷歌母公司Alphabet的CEO劈柴(Sundar Pichai)通了電話,但他表示不便透露此次談話的細節。

作爲一家大公司,谷歌對(duì)于AI的态度一向(xiàng)保守,甚至保守到,眼睜睜看著(zhe)自己在聊天AI機器人之戰中被(bèi)甩在後(hòu)面(miàn)。

早在2015年,谷歌的圖像識别AI曾將(jiāng)黑人标記爲「大猩猩」,招緻的批評讓谷歌成(chéng)爲驚弓之鳥。

在OpenAI推出Dall-E 2、名震全球之前,谷歌就有類似模型,但并沒(méi)有發(fā)布,因爲谷歌認爲需要對(duì)AI生成(chéng)的内容負責。

而早在2021年,谷歌就已有了類似ChatGPT的LaMDA聊天機器人,但谷歌始終未發(fā)布。直到2022年11月底,OpenAI憑ChatGPT占盡風頭。

如今,谷歌首席科學(xué)家Jeff Dean在一份聲明中表示:「我們仍然緻力于對(duì)人工智能(néng)采取負責任的态度,我們正在不斷學(xué)習了解新出現的風險,同時也在大膽創新。」

1972年,Hinton在愛丁堡大學(xué)開(kāi)始了他的研究生生涯。

在那裡(lǐ),他首次開(kāi)始研究神經(jīng)網絡——一種(zhǒng)通過(guò)分析數據來學(xué)習技能(néng)的數學(xué)系統。

當時,很少有研究人員相信這(zhè)個觀點。但這(zhè)成(chéng)了他畢生的心血。

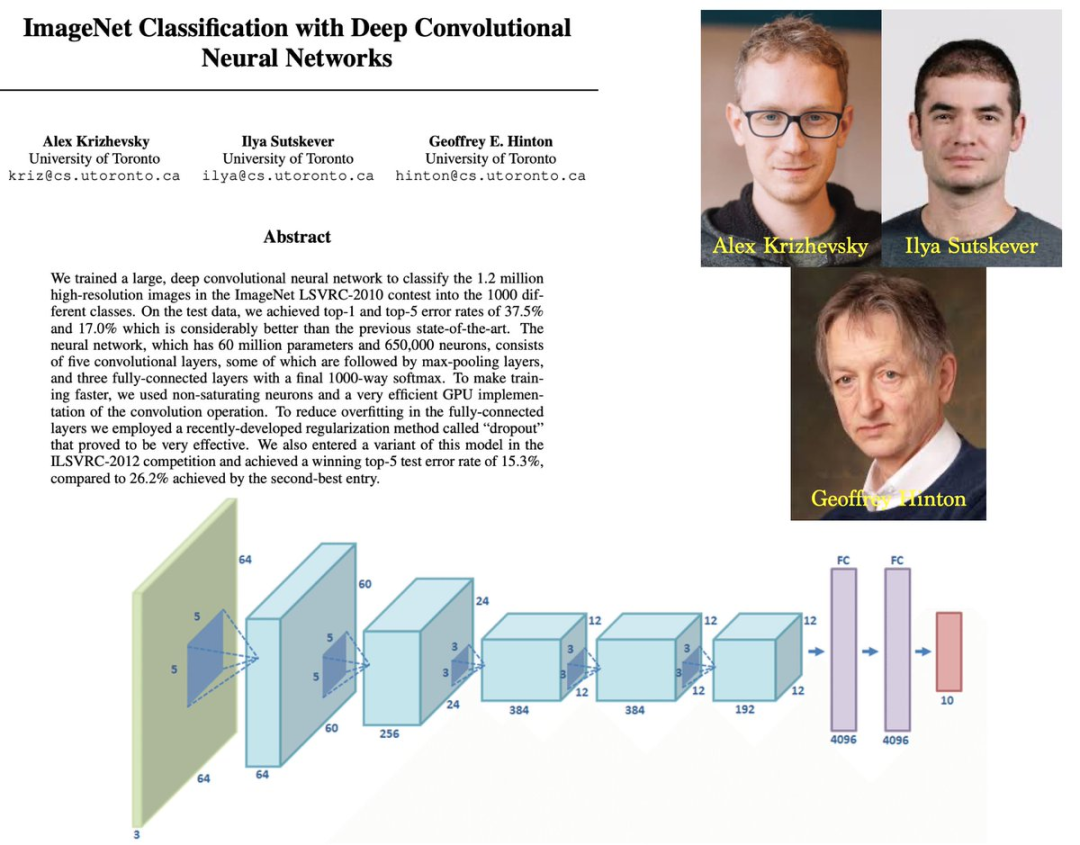

2012年,Hinton和他兩(liǎng)名學(xué)生Ilya Sutskever和Alex Krishevsky建立了一個神經(jīng)網絡,可以分析數千張照片,并自學(xué)識别花、狗和汽車等常見物體。

神經(jīng)網絡成(chéng)爲他與兩(liǎng)名學(xué)生共同創建的公司DNNresearch背後(hòu)的突破性概念,該公司最終在2013年被(bèi)谷以4400萬美元收購。

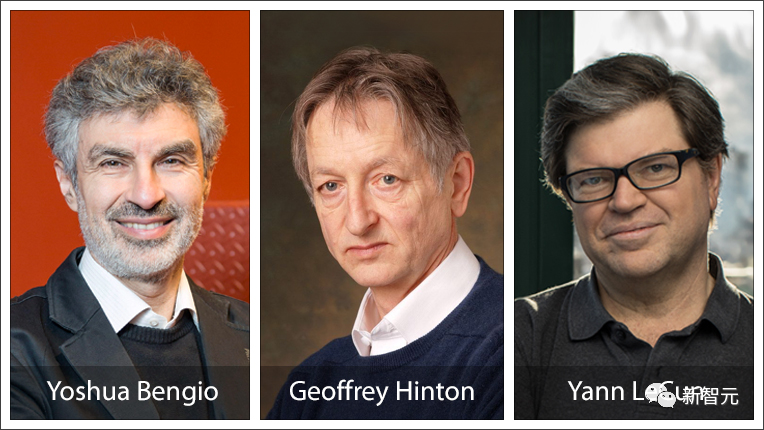

2018年,Geoffrey Hinton、Yann LeCun和Yoshua Bengio一起(qǐ)因對(duì)神經(jīng)網絡的研究獲得了2018年的圖靈獎,而神經(jīng)網絡正是ChatGPT、Bard等聊天機器人背後(hòu)的奠基性技術。

而Hinton的學(xué)生Ilya Sutskever,也在後(hòu)來成(chéng)爲OpenAI首席科學(xué)家。

大約在同一時間,谷歌、 OpenAI和其他科技公司開(kāi)始構建從大量數字文本中學(xué)習的神經(jīng)網絡。

那時的Hinton認爲,這(zhè)是機器理解和産生語言的一種(zhǒng)強大方式。當然不得不承認,比起(qǐ)人類處理語言的方式沒(méi),神經(jīng)網絡還(hái)是力不能(néng)及。

2022年,随著(zhe)谷歌和OpenAI 利用大量數據構建超強AI。

Hinton的觀點發(fā)生了重大轉變。他仍然認爲這(zhè)些系統在某些方面(miàn)不如人類的大腦,但它們在其他方面(miàn)正在超越人類的智力。

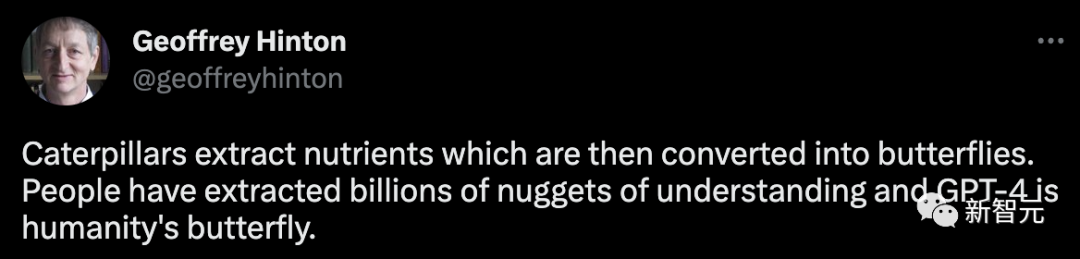

GPT-4發(fā)布當天,Hinton曾表示,

毛蟲吸取了營養之後(hòu),就會化繭爲蝶。而人類提取了數十億個理解的金塊,GPT-4,就是人類的蝴蝶。

Hinton稱贊的背後(hòu),讓許多人看到超強人工智能(néng)系統的智力已經(jīng)非同尋常。

對(duì)此,Hinton談到人工智能(néng)技術時表示,随著(zhe)科技公司改進(jìn)人工智能(néng)系統,它們變得越來越危險。

看看五年前和現在的情況,如果還(hái)要繼續傳播這(zhè)項技術,後(hòu)果就太可怕了!

在谷歌十年生涯中,Hinton一直看好(hǎo)谷歌在人工智能(néng)技術上謹慎的态度。

他表示,直到去年,谷歌一直扮演著(zhe)這(zhè)項技術的「合适管家」角色,謹小慎微地不去發(fā)布可能(néng)造成(chéng)危險的AI。

這(zhè)恰恰解釋了,爲啥谷歌在這(zhè)波人工智能(néng)浪潮中落後(hòu)的原因。

但是現在,微軟爲其必應搜索引擎接入GPT-4的能(néng)力,已經(jīng)讓谷歌焦急地不得不做點什麼(me)。

Hinton稱,科技巨頭們正在進(jìn)行一場可能(néng)無法阻止的競争。

他眼下擔心的是,互聯網上將(jiāng)充斥著(zhe)虛假的照片、視頻和文本,人們也無法去辨别什麼(me)是真實的,什麼(me)是虛假的内容。

他甚至還(hái)擔心,人工智能(néng)技術遲早會颠覆就業市場。

如今,像ChatGPT這(zhè)樣(yàng)的聊天機器人往往能(néng)很好(hǎo)地輔助人類工作,甚至取代律師助理、私人助理、翻譯、以及其他處理死記硬背任務的人。

未來,他表示自己很擔憂,GPT-4叠代會對(duì)人類構成(chéng)威脅,強AI從大量數據中能(néng)夠學(xué)到意想不到的行爲。

人工智能(néng)系統不僅可以生成(chéng)代碼,而且自己運行代碼。前段時間爆火的Auto-GPT就是一個非常典型的例子。

他擔心有一天真正的自主武器ーー那些殺人機器人ーー會成(chéng)爲現實。

上世紀80年代,Hinton曾是卡内基梅隆大學(xué)的計算機科學(xué)教授,但因爲不願接受五角大樓的資助,他選擇了離開(kāi)CMU,前往加拿大。當時,Hinton強烈反對(duì)在戰場上使用AI,他將(jiāng)其稱爲「機器人士兵」。

在一些人看來,類似的系統實際上比人類更聰明。Hinton表示自己曾經(jīng)認爲,這(zhè)太離譜了,最起(qǐ)碼要30-50年,甚至更久才能(néng)實現。

而現在,我不再那麼(me)想了。

許多其他專家,包括Hinton的許多學(xué)生和同事(shì),說這(zhè)種(zhǒng)威脅還(hái)僅是一種(zhǒng)假設。

他指出,谷歌和微軟,以及其他公司之間的競争,將(jiāng)升級爲一場全球性競賽。如果沒(méi)有某種(zhǒng)全球性的監管,這(zhè)場競賽將(jiāng)不會停止!

但他表示,這(zhè)也不是絕對(duì)的。與核武器不同,我們無法知道(dào)哪個公司或國(guó)家,是否在秘密研究這(zhè)項技術。

有網友認爲,Hinton對(duì)于的AI的看法太悲觀了。

我見過(guò)的ChatGPT積極應用案例遠多于消極的,但現在的趨勢是把AI描繪成(chéng)邪惡的煉金術。這(zhè)些擔憂是合理的,我們會學(xué)習,我們會糾正它,然後(hòu)我們會繼續前進(jìn)。

甚至有網友將(jiāng)其比爲天網,但我們還(hái)不能(néng)將(jiāng)其關閉。「人工智能(néng)就像潘多拉的魔盒一樣(yàng),一旦打開(kāi)就無法關閉。」

還(hái)有人對(duì)谷歌「負責任」這(zhè)一觀點提出異議:

-使用Breitbart訓練AI模型;-讓負面(miàn)信息在YouTube上大肆傳播(反過(guò)來又爲推薦算法提供依據);-散布有關安全和隐私的科學(xué)假信息;-開(kāi)除專家

谷歌大腦和DeepMind合并這(zhè)一事(shì),與此相關嗎?

還(hái)有網友發(fā)出疑問,連Hinton都(dōu)離職了,下一個會是?

标簽: AI

版權申明:本站文章部分自網絡,如有侵權,請聯系:hezuo@lyzg168.com

特别注意:本站所有轉載文章言論不代表本站觀點,本站所提供的攝影照片,插畫,設計作品,如需使用,請與原作者聯系,版權歸原作者所有

輸入您的聯系信息,我們將(jiāng)盡快和你取得聯系!

Tel:15137991270

企業QQ:210603461

Emile:hezuo@lyzg168.com

地址:洛陽市西工區王城大道(dào)221号富雅東方B座1711室

網站:https://www.lyzg168.com

我們的微信

關注兆光,了解我們的服務與最新資訊。

Copyright © 2018-2019 洛陽霆雲網絡科技有限公司